El Ecosistema del Desarrollo Web No Se Detiene

Durante años, el desarrollo de interfaces de usuario ha estado dominado por un triunvirato de titanes: React, Angular y Vue. Su enfoque, basado en el concepto del Virtual DOM (VDOM), revolucionó la forma en que construimos aplicaciones web interactivas. Sin embargo, en el vertiginoso mundo de la tecnología, la hegemonía es siempre temporal. Una nueva generación de frameworks y librerías está emergiendo con fuerza, desafiando los paradigmas establecidos y prometiendo un futuro más rápido, eficiente y con una mejor experiencia para el desarrollador.

Estos nuevos contendientes no son simples variaciones de lo ya existente; proponen un cambio fundamental en la arquitectura. Su principal punto en común es el abandono o la reinvención del Virtual DOM, buscando eliminar capas de abstracción para acercarse más al rendimiento nativo del navegador. Analicemos quiénes son los protagonistas de esta silenciosa revolución.

Svelte: El Framework que Desaparece

Si hay un nombre que resuena con fuerza en esta nueva ola, es Svelte. Su propuesta es radicalmente diferente: Svelte no es una librería que se ejecuta en el navegador del usuario, sino un compilador que procesa tu código durante la fase de construcción (build time). El resultado es un paquete de JavaScript vainilla, altamente optimizado y sin el ‘overhead’ de un framework en tiempo de ejecución.

En lugar de comparar un árbol virtual con el DOM real para determinar qué actualizar, Svelte sabe exactamente qué partes de la interfaz cambiarán cuando el estado de la aplicación se modifique. Esto se traduce en un rendimiento excepcional y en paquetes de aplicación mucho más pequeños.

- Menor tamaño de paquete: Al no incluir una librería de framework en el cliente, las aplicaciones Svelte son increíblemente ligeras.

- Reactividad real sin VDOM: La reactividad está integrada en el propio lenguaje. El compilador genera el código imperativo preciso para actualizar el DOM.

- Curva de aprendizaje suave: Su sintaxis es muy cercana a HTML, CSS y JavaScript puros, lo que facilita su adopción por parte de desarrolladores con experiencia básica en la web.

SolidJS: La Reactividad Granular al Extremo

A primera vista, el código de SolidJS puede parecer casi idéntico al de React. Utiliza JSX y conceptos familiares como componentes y ‘props’. Sin embargo, bajo la superficie, su funcionamiento es completamente distinto. SolidJS lleva el concepto de reactividad a su máxima expresión, eliminando por completo el Virtual DOM en favor de un sistema de seguimiento de dependencias ultra preciso.

Cuando un dato cambia, SolidJS no vuelve a ejecutar el componente completo. En su lugar, actualiza únicamente el nodo del DOM específico que depende de ese dato. Este enfoque, conocido como ‘reactividad fina’ o ‘granular’, le otorga un rendimiento que compite directamente con el código JavaScript nativo escrito a mano, posicionándose consistentemente en la cima de todos los benchmarks de rendimiento.

Qwik: La Promesa de la ‘Resumabilidad’

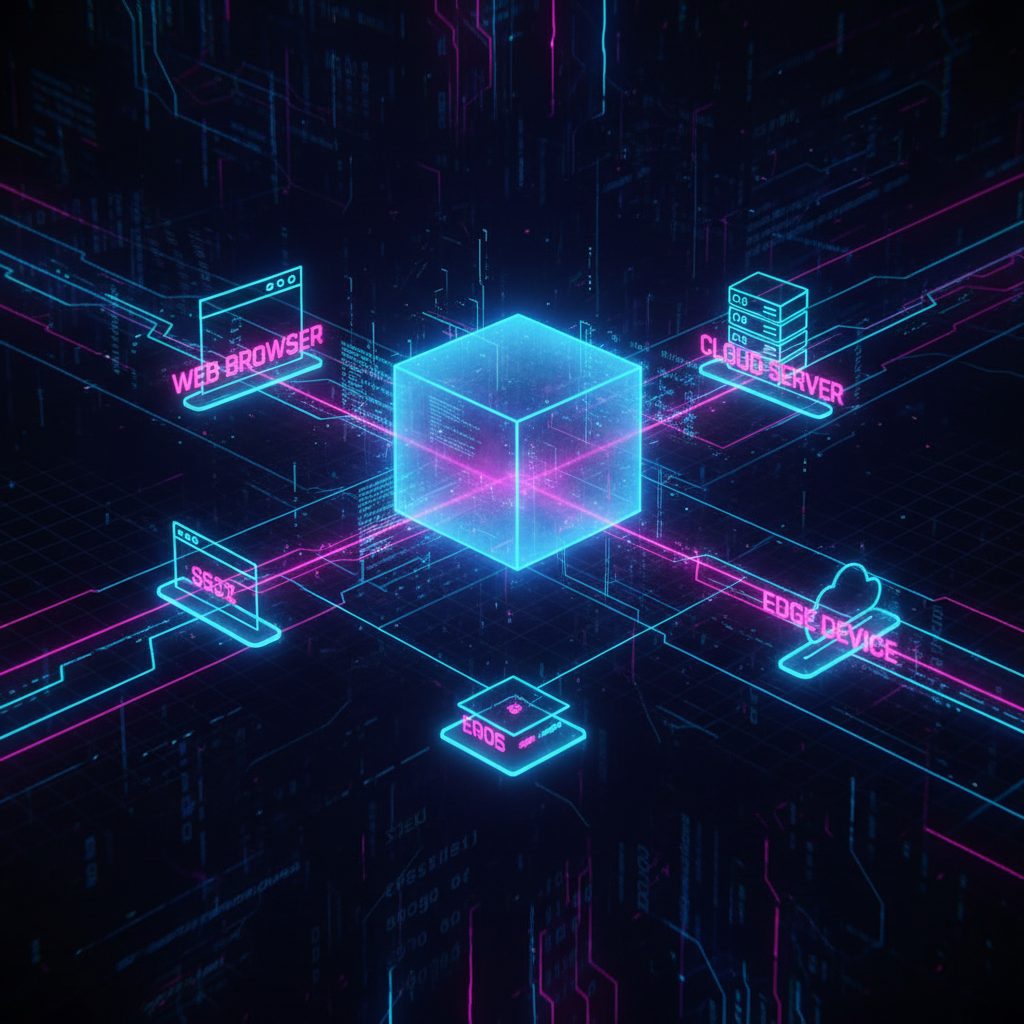

Qwik, creado por Miško Hevery (el inventor de Angular), aborda uno de los problemas más complejos de las aplicaciones web modernas: el tiempo hasta la interactividad (Time to Interactive). Las técnicas actuales, como la hidratación, renderizan la página en el servidor, pero luego deben ejecutar gran parte del mismo código en el cliente para hacerla interactiva, lo que bloquea el hilo principal.

Qwik introduce el concepto de ‘resumabilidad’ (resumability). En lugar de hidratar, Qwik pausa la ejecución en el servidor y la reanuda en el cliente exactamente donde se quedó, y solo cuando el usuario interactúa con una parte específica de la página. Este enfoque tiene un impacto revolucionario en el rendimiento de carga inicial.

- Renderizado en el servidor: La aplicación se renderiza como HTML estático en el servidor.

- Serialización del estado: Todo el estado de la aplicación y los ‘listeners’ de eventos se serializan directamente en el HTML.

- Reanudación en el cliente: El navegador carga el HTML y la página es visible instantáneamente. El JavaScript solo se descarga y ejecuta bajo demanda, cuando el usuario realiza una acción concreta.

Visión a Futuro: ¿El Fin del Virtual DOM?

Svelte, SolidJS y Qwik son solo la punta del iceberg de una tendencia clara: la búsqueda de un rendimiento superior y una experiencia de desarrollo más simple mediante la eliminación de abstracciones costosas. Si bien React y sus contemporáneos no desaparecerán de la noche a la mañana —su ecosistema y base de usuarios son gigantescos—, estas nuevas herramientas están marcando el camino a seguir.

A corto y mediano plazo, veremos cómo sus ideas (compilación anticipada, reactividad granular, carga perezosa inteligente) influencian cada vez más a los frameworks establecidos. Para los desarrolladores, este es un momento emocionante. Explorar estas alternativas no solo abre la puerta a la creación de aplicaciones más rápidas y eficientes, sino que también nos obliga a repensar los fundamentos sobre los que hemos construido la web moderna. El futuro del desarrollo frontend ya no es virtual; es compilado, granular y resumible.